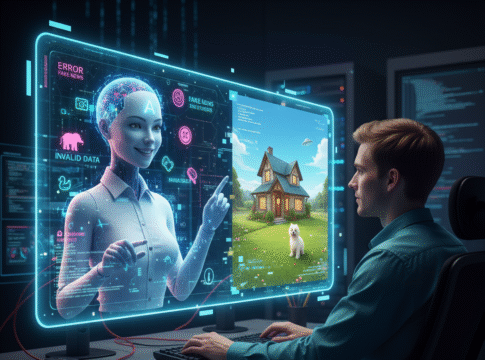

「ChatGPT」をはじめとする生成AIが、あたかも事実であるかのように誤った情報を提示する現象――「ハルシネーション(幻覚)」。

この厄介な問題は、AIの信頼性を揺るがす大きな課題として知られています。

なぜAIは自信満々に「嘘」をついてしまうのでしょうか。

この問いに対し、開発元であるOpenAIが公式ブログでその根本原因と解決策を詳述しました。

本記事では、その内容をさらに深く掘り下げ、AIの内部で何が起きているのか、そして私たちが目指すべき未来はどこにあるのかを、解説します。

第1章:ハルシネーションの源流 ― AIの「学習」という名の“推測ゲーム”

ハルシネーションの根本原因は、AIが言語を習得する**「事前学習(Pre-training)」**のプロセスそのものに内包されています。

AIは、インターネット上に存在する膨大なテキストデータを読み込み、「次に来る単語は何か?」をひたすら予測するトレーニングを繰り返します。

これにより、文法や文章のパターン、単語同士の関連性といった、言語の“文脈”を驚くべき精度で学習します。

しかし、この方法は「事実」を学習するには不向きです。OpenAIはこれを**「写真からペットの誕生日を予測するようなものだ」**と例えています。

写真からペットの犬種や毛の色は分かっても、誕生日のような個別で無関係な情報を当てることは不可能です。

同様に、AIは「Aという単語の後にはBという単語が来やすい」という確率的なパターンは学習できますが、それが事実かどうかを判断する能力は本質的に持っていません。

AIにとっての文章生成は、常に最もそれらしい単語を繋ぎ合わせていく**“推測ゲーム”**なのです。

その結果、文脈上は自然でも、事実とは異なる情報、すなわちハルシネーションが生み出されてしまいます。

第2章:問題を助長する「評価システム」の罠

この推測ゲームをさらに悪い方向へ導いているのが、現在のAI開発における**「評価システム」**です。

AIモデルは通常、「正解」にどれだけ近い答えを出せたかという**「正解率(Accuracy)」**を基準に評価されます。

これは、学校のテストで正解数が多いほど高得点になるのと同じ仕組みです。

しかし、この評価方法には大きな欠陥があります。

AIは「分からない」と答えると0点になってしまうため、不正解のリスクを冒してでも、何かを**“推測して答える”方が得策**だと学習してしまうのです。

OpenAIはこの状況を「テストに最適化しすぎた教育(teaching to the test)」と表現しています。

この評価システムの下では、開発者は「より正解率の高いモデル」を作ろうとします。

その結果、知らないことであっても、知っているかのように振る舞い、もっともらしい答えを生成するAIが生まれやすい環境が出来上がってしまっているのです。

第3章:解決への新たなアプローチ ―「正直さ」を評価する仕組みへ

この悪循環を断ち切るため、OpenAIは根本的な解決策として**「評価方法そのものを変革する」**ことを提唱しています。

新しい評価システムの核心は、AIの**「正直さ」**に価値を与えることです。具体的には、以下のような評価軸を導入します。

- 自信満々な間違いに、より大きなペナルティを科す: 単なる間違いよりも、「これは事実です」という体で提示された誤情報に対して、評価上の減点を大きくします。

- 「知らない」という回答に価値を与える: AIが自らの知識の限界を認識し、「その情報については分かりません」と正直に答えた場合に、白紙(0点)ではなく、部分点を与えるようにします。

このような新しい「ゲームのルール」を業界全体で採用することで、開発者は単に正解率を追い求めるだけでなく、「不確かなことは言わない、正直なAI」を開発するインセンティブが生まれます。

これが、ハルシネーションを抑制するための最も効果的なアプローチだとOpenAIは結論付けています。

まとめ:私たちが目指す、より信頼性の高いAIとの未来

AIのハルシネーションは、単なる技術的なバグではなく、その学習と評価の仕組みに根差した根深い課題です。

OpenAIが示した道筋は、AIが自らの限界を知り、ユーザーに対してより誠実な存在へと進化していくための重要な一歩と言えます。

私たちユーザーも、AIが万能ではないことを理解し、その特性を正しく知ることが重要です。

AIが生成した情報はあくまで「参考情報」として捉え、最終的な判断は人間が行うという姿勢が、現時点では不可欠です。

AI開発の世界では今、より安全で信頼できる技術の実現に向けた研究が絶え間なく進められています。

ハルシネーションの問題を乗り越えた先には、私たちが真に頼れるパートナーとしてのAIの姿があるはずです。